- 课程概览

- 授课讲师

- 课程大纲

- 课程概览

- 授课讲师

- 课程大纲

自然语言处理( Natural Language Processing, NLP)是计算机科学领域与人工智能领域中的一个重要方向。它研究能实现人与计算机之间用自然语言进行有效通信的各种理论和方法。自然语言处理是一门融语言学、计算机科学、数学于一体的科学。

课程概览

课程概览

本课程以自然语言算法为主体,讲解各种自然语言处理网络。在讲解网络过程中,以实际的例子和可视化的方式形象理解。部分算法会讲解实际算法推导。在讲解完每个网络后,都会用keras解决一个具体的问题。可以强化对算法的理解。

二、课程目标

掌握自然语言处理基本属于

理解词向量技术

掌握CNN、RNN网络

掌握Seq2Seq架构

掌握Transformer架构

第一阶段:自然语言处理基础

在该阶段,主要学习基本术语、基础知识、词向量等内容

第二阶段:情感分析

在该阶段,主要学习自然语言处理中常用网络,包括CNN、RNN、LSTM等。

第三阶段:序列到序列

在该阶段,主要学习Seq2Seq架构以及Transformer架构。

授课讲师

授课讲师

腾讯云社区年度最佳作者,csdn博客专家。 参与iVX低代码平台网站海外版编写重构,编写小型开源Web框架。 熟练掌握C、Python、Java等语言;PythonWeb、Android开发、计算机视觉、自然语言处理。 熟悉js、kotlin等语言;熟悉vue、react等前端框架。熟悉OpenCV、Sklearn、Pytorch等框架和模块。熟悉各种神经网络,如DNN、CNN、RNN、word2vec,熟悉attention机制以及bert预训练模型。 上课理论实践结合,例子新颖,案例贴近生活,把技术带入生活。 循循善诱,平易近人;注意启发和调动学生的积极性,课堂气氛较为活跃;例题丰富,不厌其烦,细心讲解,虚心并广泛听取学生的意见和反馈信息,做到及时修正和调整自己的知识的传授方式。

课程大纲

课程大纲

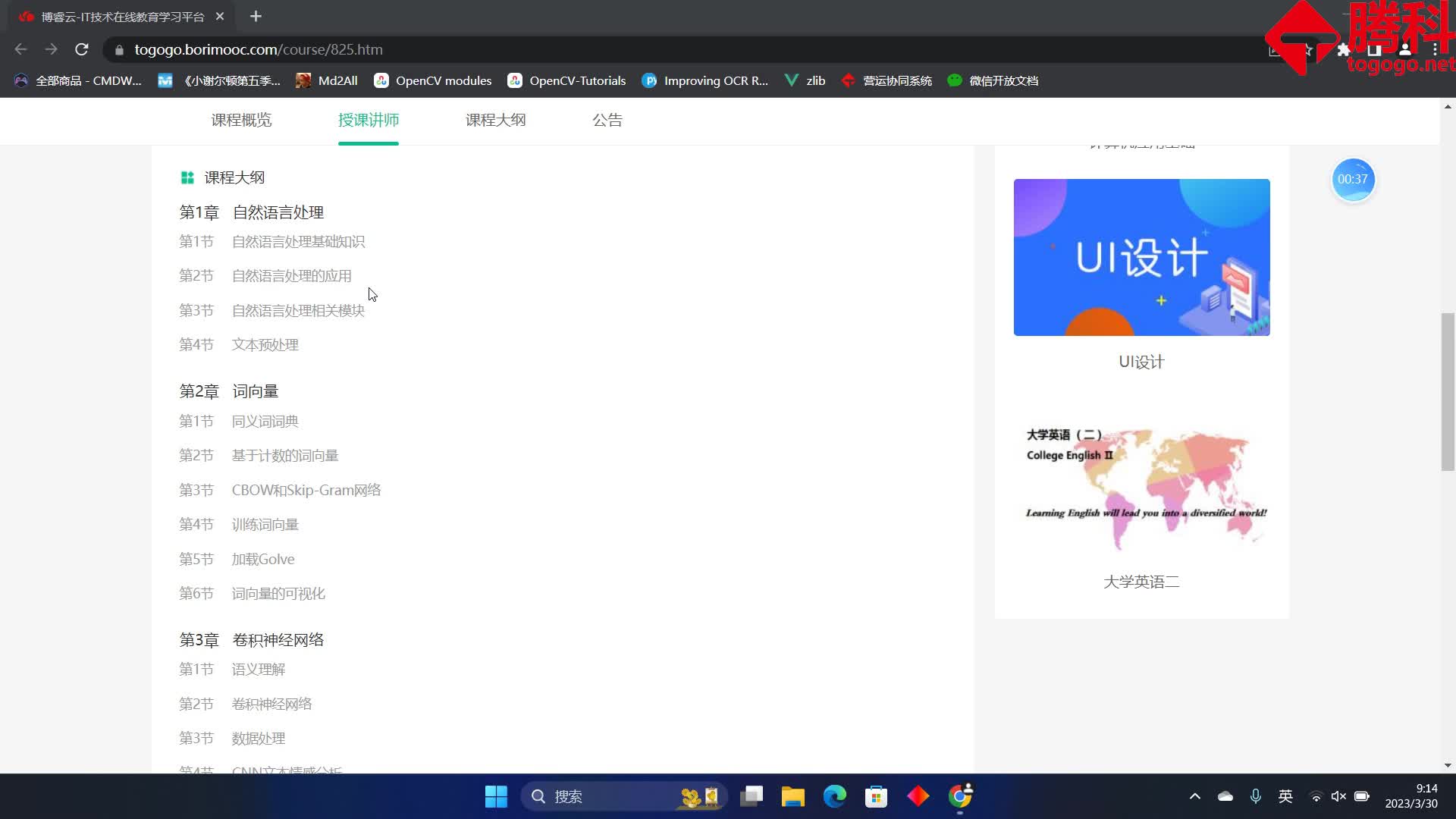

- 第1章自然语言处理

- 第1节自然语言处理基础知识

- 第2节自然语言处理的应用

- 第3节自然语言处理相关模块

- 第4节文本预处理

- 第2章词向量

- 第1节同义词词典

- 第2节基于计数的词向量

- 第3节CBOW和Skip-Gram网络

- 第4节训练词向量

- 第5节加载Golve

- 第6节词向量的可视化

- 第3章卷积神经网络

- 第1节语义理解

- 第2节卷积神经网络

- 第3节数据处理

- 第4节CNN文本情感分析

- 第4章循环神经网络RNN

- 第1节概率和语言模型

- 第2节RNN

- 第3节时序数据处理

- 第4节RNN文本情感分析

- 第5章带有门的的RNN

- 第1节RNN存在的问题

- 第2节LSTM和GRU

- 第3节双向RNN

- 第4节LSTM文本情感分析

- 第6章Seq2Seq模型

- 第1节编码-解码架构

- 第2节数据处理

- 第3节编码器的实现

- 第4节解码器的实现

- 第5节组装Seq2Seq网络

- 第6节使用Seq2Seq网络

- 第7节注意力机制

- 第7章基于预训练网络模型

- 第1节Self-Attention

- 第2节Bert详细介绍

- 第3节基于Bert的文本情感分析

- 第4节Transformer架构

| 节数 | 上课时间 | 星期一 | 星期二 | 星期三 | 星期四 | 星期五 | 星期六 | 星期天 |

|---|---|---|---|---|---|---|---|---|

| 第1节 | 08:00 - 08:40 | |||||||

| 第2节 | 09:00 - 09:40 | |||||||

| 第3节 | 10:00 - 10:40 | |||||||

| 第4节 | 11:00 - 11:40 | |||||||

| 第5节 | 14:00 - 14:40 | |||||||

| 第6节 | 15:00 - 15:40 | |||||||

| 第7节 | 16:00 - 16:40 | |||||||

| 第8节 | 17:00 - 17:40 |

| 天数 | 上课日期 | 上课时间 | 内容 |

|---|

相关竞赛

相关课件 更多

-

pptx

第7章 基于预训练网络模型

大小:2.67MB

2023-04-13

-

pptx

第6章 seq2seq模型

大小:1.99MB

2023-04-13

-

pptx

第5章 带有门的RNN

大小:2.43MB

2023-04-13

-

pptx

第4章 循环神经网络

大小:1.04MB

2023-04-13

-

pptx

第3章 卷积神经网络

大小:2.42MB

2023-04-13

-

pptx

第2章 词向量

大小:1.77MB

2023-04-13

020-38289118 转 171

020-38289118 转 171